Les chercheurs ont découvert un nouveau moyen de cibler les dispositifs à commande vocale, en propageant des ondes ultrasonores à travers des matériaux solides afin d’interagir avec eux, et de les compromettre en utilisant des commandes vocales inaudibles, tout ceci à l’insu des victimes.

Caractéristiques du SurfingAttack

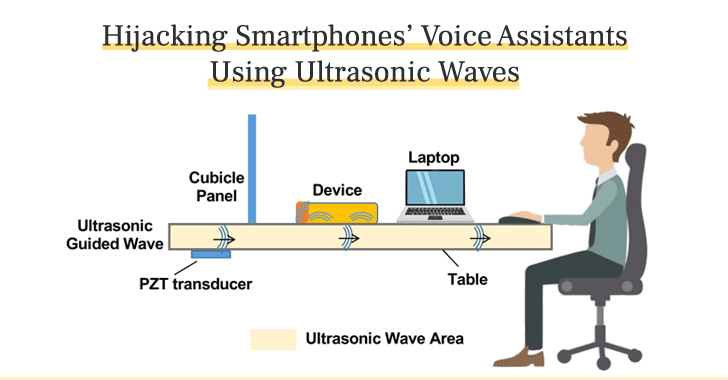

Appelée « SurfingAttack », l’attaque tire parti des propriétés uniques de la transmission acoustique dans les matériaux solides — comme les tables — pour « permettre de multiples rondes d’interactions entre l’appareil à commande vocale et l’attaquant sur une plus longue distance et sans avoir besoin d’être en ligne de mire. »

Ce faisant, il est possible pour un attaquant d’interagir avec les appareils à l’aide des assistants vocaux, de détourner les codes d’authentification SMS à deux facteurs, et même de placer des appels frauduleux. Les chercheurs décrivent dans le document, qu’il est également possible de contrôler l’appareil de la victime discrètement.

L’éude a été publiée par un groupe de chercheurs de l’Université de l’État du Michigan, de l’Université de Washington à St. Louis, de l’Académie chinoise des sciences et de l’Université du Nebraska-Lincoin.

Les résultats ont été présentés lors du Network Distributed System Security Symposium (NDSS) le 24 février dernier à San Diego.

Fonctionnement du SurfingAttack

Les microphones MEMS, la norme dans la plupart des appareils contrôlés par assistant vocal, contiennent une petite plaque intégrée appelée diaphragme. Lorsque ce dernier reçoit des ondes sonores ou lumineuses, il les traduit en signal électrique, signal qui est ensuite décodé dans les commandes elles-mêmes.

Cette nouvelle attaque exploite la nature non linéaire des circuits de microphone MEMS pour transmettre des signaux ultrasonores malveillants — des ondes sonores haute fréquence inaudibles pour l’oreille humaine — à l’aide d’un transducteur piézoélectrique (d’une valeur de 5 $) collé à une surface de table, par exemple. De plus, les attaques peuvent être exécutées jusqu’à 9 mètres de l’appareil cible.

Pour cacher l’attaque à la victime, les chercheurs ont ensuite émis une onde ultrasonore guidée pour ajuster le volume de l’appareil suffisamment bas afin de rendre les réponses vocales imperceptibles, tout en étant en mesure d’enregistrer les réponses vocales de l’assistant via un dispositif d’écoute caché plus près de l’appareil de la victime sous la table.

Une fois configuré, un interphone peut non seulement activer les assistants vocaux, par exemple avec les commandes « OK Google » ou « Hey Siri », mais aussi générer des commandes d’action comme « lire mes messages » ou « appeler Sam avec haut-parleur » en utilisant le système de Text-To-speech (TTS) — tous transmis sous forme de signaux d’ondes guidés par ultrasons. Ces signaux peuvent ensuite se propager pour contrôler les dispositifs.

Quels sont les appareils les plus vulnérables ?

SurfingAttack a été testé sur une grande variété d’appareils qui utilisent des assistants vocaux, tels que Google Pixel, Apple iPhone, Samsung Galaxy S9 et Xiaomi Mi 8, et chacun d’entre eux a été détecté vulnérable aux attaques d’ondes ultrasonores. On a également constaté que l’attaque fonctionnait malgré l’utilisation de différentes surfaces de table (par exemple, métal, verre, bois) et de différentes configurations de téléphone.

Cependant l’expérience a échoué sur deux appareils, le Huawei Mate 9 et le Samsung Galaxy Note 10+, même si ce dernier devient vulnérable lors de l’installation de Lineageos. Il a été observé que les sons enregistrés des commandes échographiques du Galaxy Note 10+ étaient très faibles, les chercheurs ont attribué l’échec « aux structures et matériaux du corps du téléphone. »

Un point positif est que les assistants vocaux d’Amazon et de Google, respectivement Amazon Echo et Google Home, ne sont pas vulnérables à cette attaque.

Des attaques vocales à la hausse

Bien qu’il n’y ait, jusqu’à présent, aucune indication sur le fait que l’attaque ait été exploitée, ce n’est pas la première fois que ce genre d’attaques par injection est découvert.

En effet, la recherche s’appuie sur une série d’études récentes — Backdoor, Lipread et Dolphinattack — qui démontrent la possibilité d’exploiter la non linéarité des microphones pour transmettre des commandes inaudibles au système via des signaux ultrasonores.

De plus, une étude menée par des chercheurs de l’Université des communications électroniques de Tokyo et de l’Université du Michigan, a révélé une série d’attaques — appelées Light Commands — qui utilisent des lasers pour injecter des commandes inaudibles dans les téléphones intelligents et les haut-parleurs, et les poussent subrepticement à ouvrir des portes, à faire des achats sur des sites e-commerce ou même à démarrer des véhicules.

Alors que cette attaque exige que le faisceau laser soit en ligne de mire directe avec le dispositif cible en question, les capacités de propagation du SurfingAttack éliminent ce besoin, permettant ainsi à un attaquant potentiel d’interagir à distance avec un dispositif et d’exécuter des commandes non autorisées pour accéder à des informations sensibles à l’insu de la victime.

En résumé, ces dernières recherches présentent un nouveau vecteur d’attaque qui impose aux fabricants de dispositifs d’ériger de nouvelles défenses de sécurité. Protéger les dispositifs contre les attaques vocales est d’autant plus important quand on connaît la tendance que représente la maison connectée.

En effet, l’assistance vocale tend à devenir une condition sine qua non de la maison intelligente fonctionnant avec la domotique.